통계적 학습이론

| 기계 학습과 데이터 마이닝 |

|---|

|

통계적 학습이론(統計的學習理論, 영어: Statistical learning theory)은 통계학 및 함수해석학 분야에서 기계학습 도면을 위한 체계이다.[1][2] 통계적 학습이론은 데이터에 근거하는 예측함수를 찾는 문제를 다룬다. 통계적 학습이론은 컴퓨터 비전 및 음성인식, 생물정보학, 야구 따위의 스포츠 분야에서 성공적인 응용을 이끌어냈다.[3]

개요[편집]

학습의 목표는 이해와 예측이다. 학습은 지도 학습, 비지도 학습, 온라인 학습 및 강화 학습을 비롯한 여러 범주로 분류된다. 통계적 학습이론의 관점에서는 지도 학습이 가장 잘 이해된다.[4] 지도 학습은 훈련된 데이터 집합으로부터 학습하는 것을 포함한다. 훈련의 모든 포인트는 입·출력쌍이며, 입력은 출력에 매핑된다. 학습 문제는 학습된 함수가 미래의 입력으로부터의 결과를 예측하는 데 사용될 수 있도록, 입력과 출력 사이를 매핑하는 함수를 추론하는 것으로 구성된다.

출력 유형에 따르는 지도학습 문제는, 회귀문제이거나 분류문제 중 하나이다. 출력값에 연속범위가 있다면 회귀문제이다. 옴의 법칙으로 예를 들면, 회귀분석은 전압을 입력으로, 전류를 출력으로 수행될 수 있다. 회귀분석은 전압과 전류 사이의 함수적 관계는 다음과 같이 로 파악된다.

분류 문제에서 출력은 별개의 라벨 집합의 요소가 된다. 분류는 기계학습 응용에서 매우 일반적이다. 이를테면, 안면인식에서는 사람의 얼굴 화상이 입력되고, 출력 라벨은 그 사람의 이름이 된다. 입력은 화상에서 픽셀을 나타내는 다차원 벡터로 표현된다.

훈련 집합을 기반으로 함수를 학습한 다음에는, 해당 함수가 훈련 집합에 나타나지 않는 데이터의 테스트 집합에서 그 유효성이 평가된다.

형식 기술[편집]

를 벡터공간의 모든 가능한 입력으로 취하고, 를 벡터공간의 모든 가능한 출력으로 취한다. 통계적 학습이론에서는 곱공간 위에 미지의 확률분포가 존재한다는 관점을 취한다. 이를테면 미지의 가 존재한다. 훈련집합은 이 확률분포 위에 있는 개의 샘플로 이루어져 있고, 다음과 같이 적힌다.

는 훈련집합에서의 입력벡터이며, 는 그것에 상응하는 출력이다.

이러한 형식주의에서, 추론문제(inference problem)는 일 때의 함수 를 찾는 것으로 구성된다. 를 함수의 공간이고 할 때, 는 가설공간(hypothesis space)이라고 불린다. 가설공간은 알고리즘이 검색할 함수의 공간이다. 를 손실함수, 예측치 간의 차이에 대한 측정단위를 , 실제 값을 라고 하자. 기대위험은 다음과 같이 정의된다.

목표함수, 즉 선택가능한 최적의 함수 는 이하를 만족할 때 주어진다.

확률분포 는 미지이기 때문에, 기대위험에는 대리측정(proxy measure)이 쓰여야만 한다. 이 측정은, 미지의 확률분포 위에 있는 샘플들로 이루어진 훈련집합에 기초한다. 이는 경험적 위험이라고 불린다.

경험적 위험(empirical risk)을 최소화하는 함수 를 선택하는 학습 알고리즘을 경험적 위험 최소화라고 부른다.

손실함수[편집]

문제가 회귀인지 분류인지에 따라 상이한 손실함수가 사용된다. 손실함수의 선택은, 학습 알고리즘에 의해 선택될 함수 의 결정요인이다. 손실함수는 또한 알고리즘의 수렴률에 영향을 미친다. 손실함수가 볼록해지는 것이 중요하다.[5]

문제가 회귀의 일종인지 분류의 일종인지에 따라 다른 손실함수가 쓰인다.

회귀문제[편집]

회귀에 대한 가장 일반적인 손실함수는 제곱 손실함수(L2-노름)이다. 이 손실함수는 범용 최소제곱법이다.

때때로 절댓값 손실(L1-노름)이 활용된다.

분류문제[편집]

어떤 의미에서 0-1 지시함수는 분류에 있어서 가장 자연스러운 손실함수이다. 예측 출력이 실제 출력과 동일할 경우 0값을 지니며, 그렇지 아니할 경우에는 1값을 지닌다. 이진분류(binary classification) 에서 이는 다음과 같다.

이 때, 는 단위계단함수이다.

정칙화[편집]

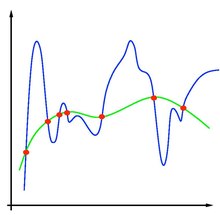

기계학습 문제에서 발생하는 주요한 문제로는 과적합이 있다. 학습은 예측문제이므로, 학습목표는 (전례가 있는) 데이터에 최적인 함수를 찾지 않고 미래의 입력의 결과를 가장 정확하게 예측할 수 있는 함수를 얻는 것이다. 경험적 위험 최소화는, 이러한 과적합의 위험을 갖는다. 즉, 데이터와 정확히 일치하지만 미래의 출력을 잘 예측하지 못하는 함수를 찾는 것이다.

과적합은 불안정한 해답을 빚을 징후를 보인다. 훈련 집합의 작은 섭동(攝動)은 학습된 함수에 큰 변동을 일으킬 수 있다. 해답의 안정성이 보장될 수 있다면, 일반화와 일관성도 보장된다는 것을 알 수 있다.[6][7] 정칙화는 과적합 문제를 해결하고 문제를 안정화한다.

정칙화는 가설 공간 를 제한함으로써 이루어질 수 있다. 일반적인 예는 를 선형 함수로 제한하는 것이다. 이것은 선형 회귀를 표준 문제로 환원하는 것으로 볼 수 있다. 는 또한 최고차항 의 다항식, 지수함수, 또는 L1으로 구획된 함수로 제한될 수 있다. 가설공간의 제한은 과적합을 회피하는데, 이는 포텐셜 함수(potential function)의 형태가 유한하기 때문이고, 따라서 임의로 0에 근접하는 경험적 위험을 제공하는 함수의 선택을 허용하지 않는다.

정칙화의 한 예로는 티호노프 정칙화가 있다:

이 때, 는 고정된 양수 매개변수이고, 정칙화 매개변수이다. 티호노프 정칙화는 해답의 존재와 독창성, 안정성을 보장한다.[8]

같이 보기[편집]

각주[편집]

- ↑ Trevor Hastie, Robert Tibshirani, Jerome Friedman (2009) The Elements of Statistical Learning, Springer-Verlag ISBN 978-0-387-84857-0.

- ↑ Mohri, Mehryar; Rostamizadeh, Afshin; Talwalkar, Ameet (2012). 《Foundations of Machine Learning》. USA, Massachusetts: MIT Press. ISBN 9780262018258.

- ↑ Gagan Sidhu, Brian Caffo. Exploiting pitcher decision-making using Reinforcement Learning. Annals of Applied Statistics

- ↑ Tomaso Poggio, Lorenzo Rosasco, et al. Statistical Learning Theory and Applications, 2012, Class 1

- ↑ Rosasco, L., Vito, E.D., Caponnetto, A., Fiana, M., and Verri A. 2004. Neural computation Vol 16, pp 1063-1076

- ↑ Vapnik, V.N. and Chervonenkis, A.Y. 1971. On the uniform convergence of relative frequencies of events to their probabilities. Theory of Probability and its Applications Vol 16, pp 264-280.

- ↑ Mukherjee, S., Niyogi, P. Poggio, T., and Rifkin, R. 2006. Learning theory: stability is sufficient for generalization and necessary and sufficient for consistency of empirical risk minimization. Advances in Computational Mathematics. Vol 25, pp 161-193.

- ↑ Tomaso Poggio, Lorenzo Rosasco, et al. Statistical Learning Theory and Applications, 2012, Class 2

![{\displaystyle I[f]=\displaystyle \int _{X\times Y}V(f({\vec {x}}),y)\,p({\vec {x}},y)\,d{\vec {x}}\,dy}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7c97de659352fa60d6624a1f54f4d3f0b32c73af)

![{\displaystyle f=\inf _{h\in {\mathcal {H}}}I[h]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/47c982d6049c9ce70930b327589b5ff00915406f)

![{\displaystyle I_{S}[f]={\frac {1}{n}}\displaystyle \sum _{i=1}^{n}V(f({\vec {x}}_{i}),y_{i})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0418e949bbea67e3cdbe4455429c3af2c3f09781)