신경망

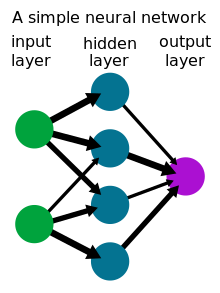

신경망(神經網) 또는 뉴럴 네트워크(neural network)는 신경회로 또는 신경의 망(網)으로, 현대적 의미에서는 인공 뉴런이나 노드로 구성된 인공 신경망을 의미한다.[1] 그러므로 신경망은 실제 생물학적 뉴런으로 구성된 생물학적 신경망이거나 인공지능(AI) 문제를 해결하기 위한 인공 신경망으로 구분할 수 있다. 생물학적 뉴런의 연결은 하중(무게)으로 모델링된다.

개요[편집]

생물학적 신경망은 화학적으로 연결되거나 기능적으로 연결된 뉴런들의 그룹으로 구성된다. 하나의 뉴런은 다른 수많은 뉴런들과 연결될 수 있으며 망 내의 뉴런과 연결점들의 모든 수는 광활하다. 연결, 즉 시냅스는 일반적으로 축삭에서 가지돌기, 수상돌기간 시냅스를 통해 구성되며[2] 다른 연결 또한 가능하다.

같이 보기[편집]

각주[편집]

- ↑ Hopfield, J. J. (1982). “Neural networks and physical systems with emergent collective computational abilities”. 《Proc. Natl. Acad. Sci. U.S.A.》 79 (8): 2554–2558. Bibcode:1982PNAS...79.2554H. doi:10.1073/pnas.79.8.2554. PMC 346238. PMID 6953413.

- ↑ Arbib, p.666